En internet se han popularizado servicios en los que grupos criminales se dedican a crear tendencias o alterar la percepción de una información en redes sociales.

Estos servicios, aunque están prohibidos por las políticas de seguridad de las principales redes sociales, son muy utilizados principalmente en época de elecciones, para difamar, transmitir desinformación o llevar tráfico a páginas cuyo contenido es diferente al prometido.

Todo esto con la intención de alterar la opinión y percepción del público frente a un tema, candidato o producto determinado. También es usado para ganar dinero por impresiones publicitarias.

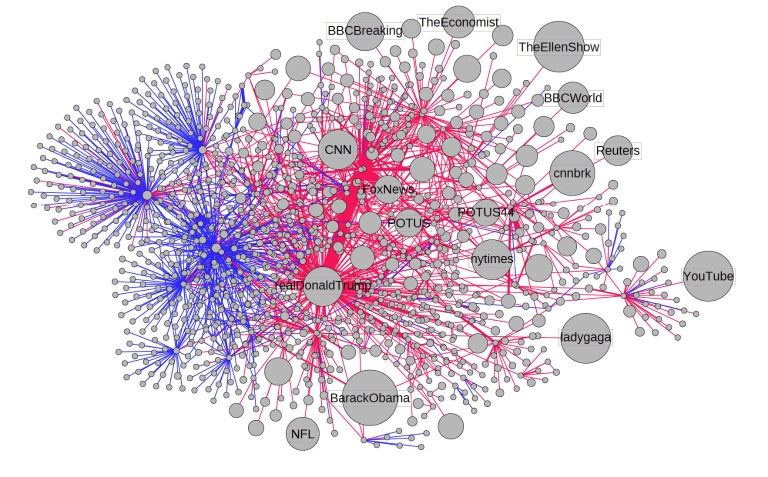

El gráfico muestra la difusión de un artículo falso que aseguraba que 3 millones de inmigrantes ilegales participaron en las elecciones presidenciales de 2016 en Estados Unidos. Los enlaces muestran que el artículo se difundió a través de retweets en azul y respuestas y menciones en rojo. Cortesía de Filippo Menczer, Universidad de Indiana.

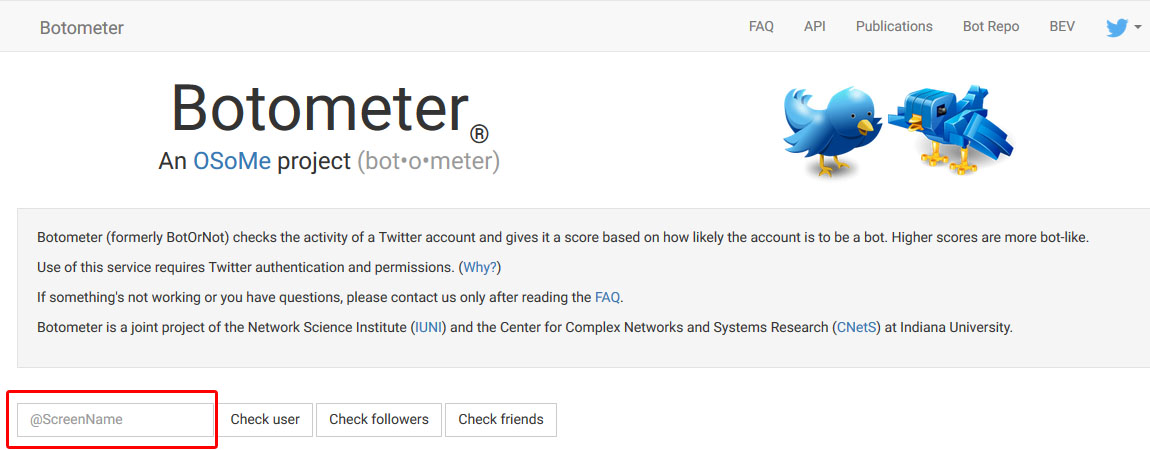

Para combatir este tipo de programas y la desinformación que producen, el Instituto de Ciencias de la Red en alianza con el Centro de Investigación de Redes y Sistemas Complejos, ambos de la Universidad de Indiana en Estados Unidos, desarrollaron ‘Botometer’.

Esta herramienta nace con la intención de ofrecer a periodistas e investigadores una forma rápida y eficiente de determinar si una cuenta de Twitter es de hecho un bot trabajando en función de un interés determinado. También funciona para detectar cuántos de los seguidores de una cuenta son bots, pues es común que los bots formen «colmenas» para trabajar juntos.

También te puede interesar: Headliner: convierte audio, texto o imágenes en videos

Botometer funciona gracias a un algoritmo de aprendizaje automático que fue entrenado para clasificar una cuenta como bot o humano basado en miles de ejemplos etiquetados.

Al chequear una cuenta, el navegador solicita información de cientos de cuentas públicas, sus trinos y sus menciones utilizando la plataforma de Twitter. Estos datos son estudiados por el algoritmo el cual extrae 1200 características para perfilar la cuenta, sus amigos, estructura social, patrones de actividad temportal, lenguaje e intención.

El resultado que el usuario obtiene es el estudio, realizado por el algoritmo, de todos los datos. Sus desarrolladores no guardan los datos más allá del indentificador de la cuenta.

1. Para comenzar a utilizarla, el usuario debe visitar la web oficial: https://botometer.iuni.iu.edu/#!/

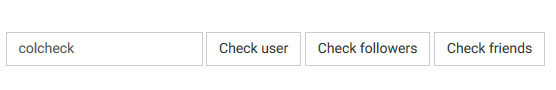

2. El usuario puede ingresar el nombre de la cuenta de Twitter en el espacio «@ScreenName». No es necesario escribir la ‘@’

3. Una vez escrito el nombre de la cuenta a chequear, el usuario debe seleccionar si desea chequear directamente a la cuenta, a sus seguidores o a sus amigos.

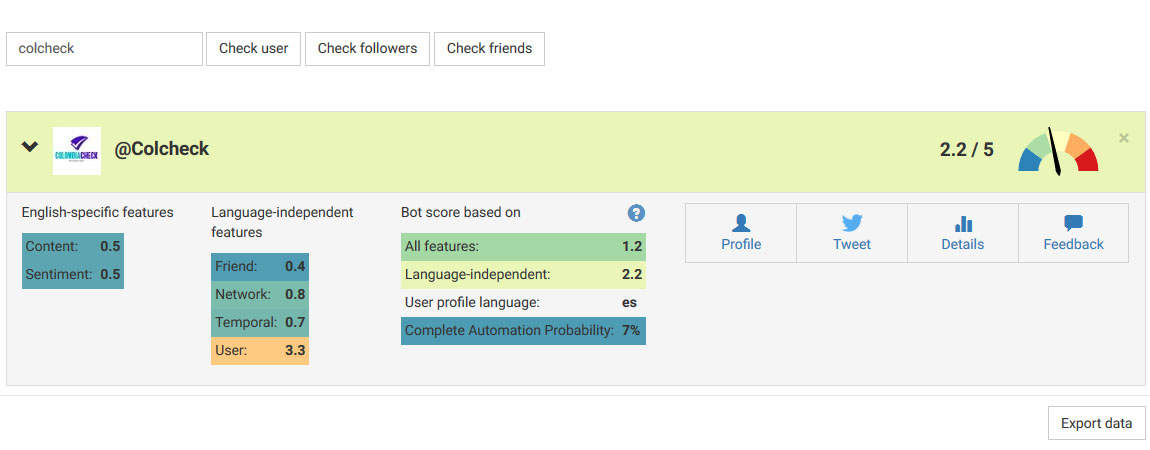

4. En este ejemplo chequeamos al usuario Colcheck:

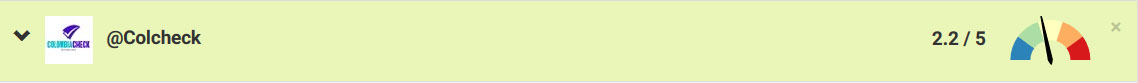

5. Al hacer clic en ‘check user’ el programa se activa y en milésimas de segundo reúnen todos los datos de la cuenta, los pasa por el algoritmo y presenta el resultado.

6. El resultado se muestra en forma de un gráfico sencillo:

La probabilidad de que sea una cuenta bot es de 2.2 sobre 5. Lo que indica que, aunque la cuenta puede utilizar software de programación de trinos, es controlada por humanos.

La probabilidad de que sea una cuenta bot es de 2.2 sobre 5. Lo que indica que, aunque la cuenta puede utilizar software de programación de trinos, es controlada por humanos.

7. Al expandir los resultados podemos observar los elementos que fueron tomados en cuenta para determinar la probabilidad de que la cuenta sea un bot: características específicas del lenguaje y el sentimiento con el que se escribieron, el estudio de amigos, red, publicaciones temporales y usuarios que interactuaron.

8. El periodista puede presionar el botón inferior derecho ‘Export Data’ para guardar los datos obtenidos en una hoja de cálculo.

Utilizando esta herramienta, es fácil determinar si una persona/campaña/producto está siendo víctima de ataques de bots con intenciones negativas.

Para comenzar a trabajar con Botometer, el usuario puede hacer clic aquí.